|

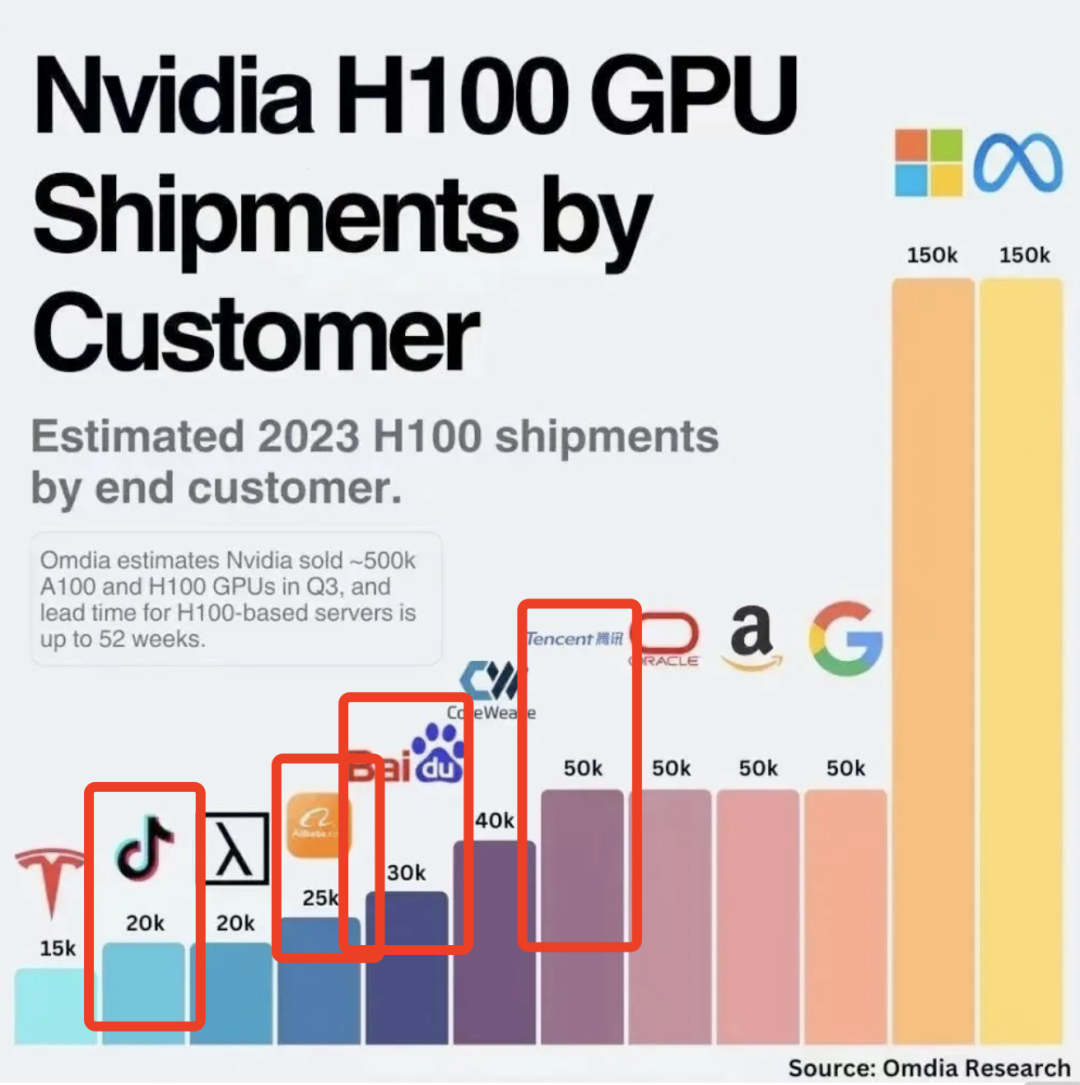

研究公司 Omidia 最近的一份报告显示,英伟达2023年Q3季度Top12的H100显卡购买客户中,腾讯、百度、阿里、字节占据其四。

此前每次英伟达的显卡一经推出,无不受到国内各大公司争抢,但现如今,情况似乎发生了逆转: 作为中国的显卡大户们,占据了英伟达1/5收入的中国科技公司,包括百度、阿巴、腾讯和字节等公司正在开始减少英伟达芯片的订单量,转向国内芯片制造商或者公司内部自研芯片。 显而易见,这“得益于”漂亮国的对华AI芯片禁售政策。 去年10月,美国发布新规阻止英伟达向中国出售尖端人工智能(AI)芯片,但是英伟达迅速为中国开发了特供芯片,在不违反规定的情况下继续在中国市场销售芯片。然而,据知情人士称,自去年11月以来,阿里、腾讯等中国云计算公司一直在测试英伟达的特供芯片样本。他们已向英伟达表明,今年向英伟达订购的芯片数量将远远少于此前原计划购买的、已经被禁的英伟达高性能芯片。 此外,NVIDIA“阉割版”芯片领先中国本土产品的性能优势正在缩小,这使得自研芯片对买家的吸引力越来越大。 市场分析,国内云计算企业对英伟达新的特供版GPU兴致缺缺的主要原因有以下几个: 首要原因是美国不断严格的监管,中国买家不确定英伟达是否有能力继续供货。 其次,新的特供版GPU为了符合新规,性能参数被大幅压缩。早前Semianalysis 透露过H20、L20 和 L2 三款芯片的规格参数。 - H20的总处理性能为2368,性能密度仅为 2.9,小于 3.2 的管制许可值; - L20的总处理性能为1912,但性能密度为 3.1,小于 3.2 的管制许可值; - L2的性能密度为 5.2,但总处理性能仅为1544,小于 1600 的管制许可值。 在具体应用中,以 H20 为例,这款芯片的峰值算力最大理论值仅为 296 TFLOPs,性能参数还不如消费级游戏显卡,消费级的 RTX 4090 显卡该数值为 661 TFLOPs。与热门的 H100 芯片相差更大,热门的 H100 芯片的这一数值为 1979 TFLOPs。 此外,在新规执行前,供应链曾传出国内各大云计算巨头均大量囤货A800 和 H800,在这两款芯片尚未完全使用完之前,国内客户对新的降级版英伟达芯片需求并不迫切。更重要的是,一再降级后的英伟达GPU特供芯片与大陆本土的产品性能差距正在缩小,大陆厂家在此时得到了国内云计算厂家的更多关注。 第三,相比一再受制的英伟达而言,供应更稳定的本土厂商更令人放心。国内云计算企业有意培养本土企业,准备AI芯片的“plan B”方案。 长远来看,鉴于美国监管机构已承诺将定期审查芯片出口管制,并可能进一步收紧相关芯片的性能限制,因而国内买家为避免不断调整技术以适应新的出口管制,不如减少英伟达产品应用,转而使用本土产品。 “如果未来几年限制可能只会变得更加严格,那么你最好现在就开始考虑更换方案。” 从供需的角度出发,未来造成英伟达在中国市场中供应比例下降的原因不难理解。 供应方来看,英伟达产品向中国客户供应受限,出货不畅,导致其高价值高端产品供应减少,而低端产品单价低,系统应用总价值不及高端产品,客户也在重新评估产品的满意度。当前来看,满意度并不高。 需求方来看,面对降级版的GPU芯片,国内客户一般有三种选择:一种是对自建云计算需求不强的企业正打消自建算力计划,转而租用大型云计算公司算力,重心转移至开放AI应用;而对自建算力需求强烈的需求方,如云计算企业、电信运营商、相关重点部门的AI计算中心等则考虑转而尝试使用与降级版性能相近的产品,培养国内供应链;或者继续使用此前囤货的 英伟达芯片,再加上购买更多的降级版GPU芯片,以满足构建算力系统的需求。 但是需要承认的是,即便是在全球范围中,英伟达在AI芯片领域构筑的护城河——CUDA计算平台以及软硬件生态,至今无人能超越,强如AMD,多年来在英伟达面前也只能屈尊“千年老二”。国内的厂家即便是在GPU产品单个性能参数上有所突破,可在整体的应用生态中,短期内仍不可能达到英伟达的高度。 各大AI大模型耗资巨大,国内云计算需求方在实际应用端还是以“稳”为主,引入其它本土厂家产品测试可以,准备“plan B”方案势在必行。但短期内大范围下单国内AI芯片,更换英伟达芯片恐怕又是另一回事了,由此来看,“转单”国产厂商的实质性行为并不会很快发生。 国内科技公司的工程师也表示,鉴于英伟达更广泛的产品生态系统以及本地替代品仍然供不应求,英伟达的芯片在未来12个月内仍将是采购重点。 总之,对国内公司而言,这一切即是机会也是挑战,自研AI芯片大规模应用的那天虽迟但总会到。

|